好的,我来为您比较一些常见的集成学习算法,并生成表格形式以便于对比:

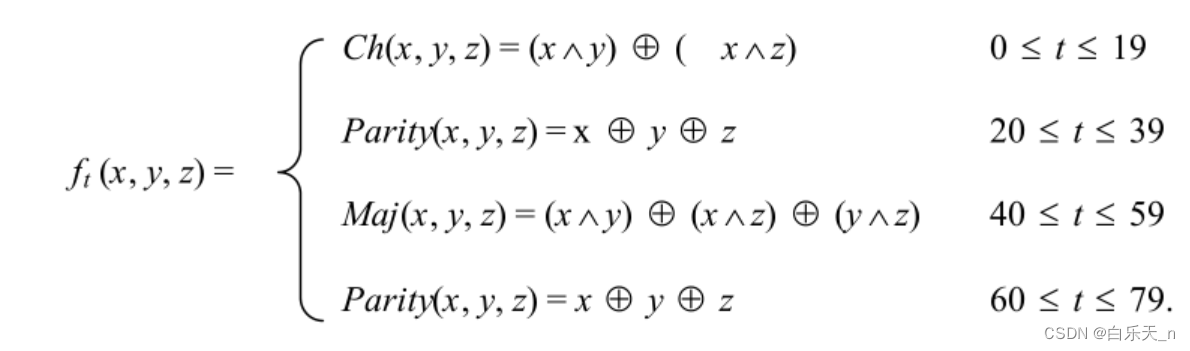

| 算法 | 主要思想和特点 | 应用场景 | 并行处理支持 | 稳定性和鲁棒性 | 主要优化策略和技术 |

|---|---|---|---|---|---|

| AdaBoost | 使用加权投票组合多个弱分类器,逐步提升分类器性能 | 二分类和多分类问题,简单数据集 | 不易并行化 | 对异常值敏感 | 样本权重调整,顺序训练 |

| Gradient Boosting | 通过减少残差的梯度来逐步构建一个强分类器 | 回归和分类问题,处理中等规模数据集 | 部分并行化 | 相对稳定 | 梯度信息利用,顺序化分裂节点 |

| XGBoost | 优化的提升树算法,结合正则化和二阶梯度优化 | 结构化数据的回归和分类问题,大规模数据集 | 高度并行化 | 较高稳定性 | 正则化,特征分裂策略,并行化训练 |

| LightGBM | 基于Histogram的提升树算法,效率高,速度快 | 大规模数据集的回归和分类问题 | 高度并行化 | 较高稳定性 | 直方图加速,并行化训练 |

| CatBoost | 处理分类变量,具有自动处理缺失值和稀疏特征的能力 | 处理各种类型的数据,包括分类变量和数值型数据 | 部分并行化 | 高稳定性 | 对分类变量的处理,梯度提升 |

| Random Forest | 通过随机选择特征和样本来构建多棵决策树,随机性强 | 处理高维度数据和非线性关系 | 高度并行化 | 相对稳定 | 随机特征选择,随机森林的平均效果 |

这个表格列出了几种常见的集成学习算法,包括AdaBoost、Gradient Boosting、XGBoost、LightGBM、CatBoost和Random Forest。它们各自的主要特点、应用场景、并行处理支持、稳定性和优化策略有所不同,选择适合的算法取决于具体的数据和任务需求。

![[数据集][目标检测]金属架螺栓螺丝有无检测数据集VOC+YOLO格式857张3类别](https://i-blog.csdnimg.cn/direct/9e2aff584cdc421c86ab5c2c8b97732c.png)